La sabiduría convencional dice: «Si no quieres que utilicen tus datos, retírate de todo».

Nosotros decimos: «Si tus datos se recopilan de todos modos, es más racional influir en cómo se utilizan».

No es: «¿Deberían las empresas tener mis datos?» (Ya los tienen).

La verdadera pregunta es: «¿Deberían mis datos contribuir a crear una IA mejor para todos?».

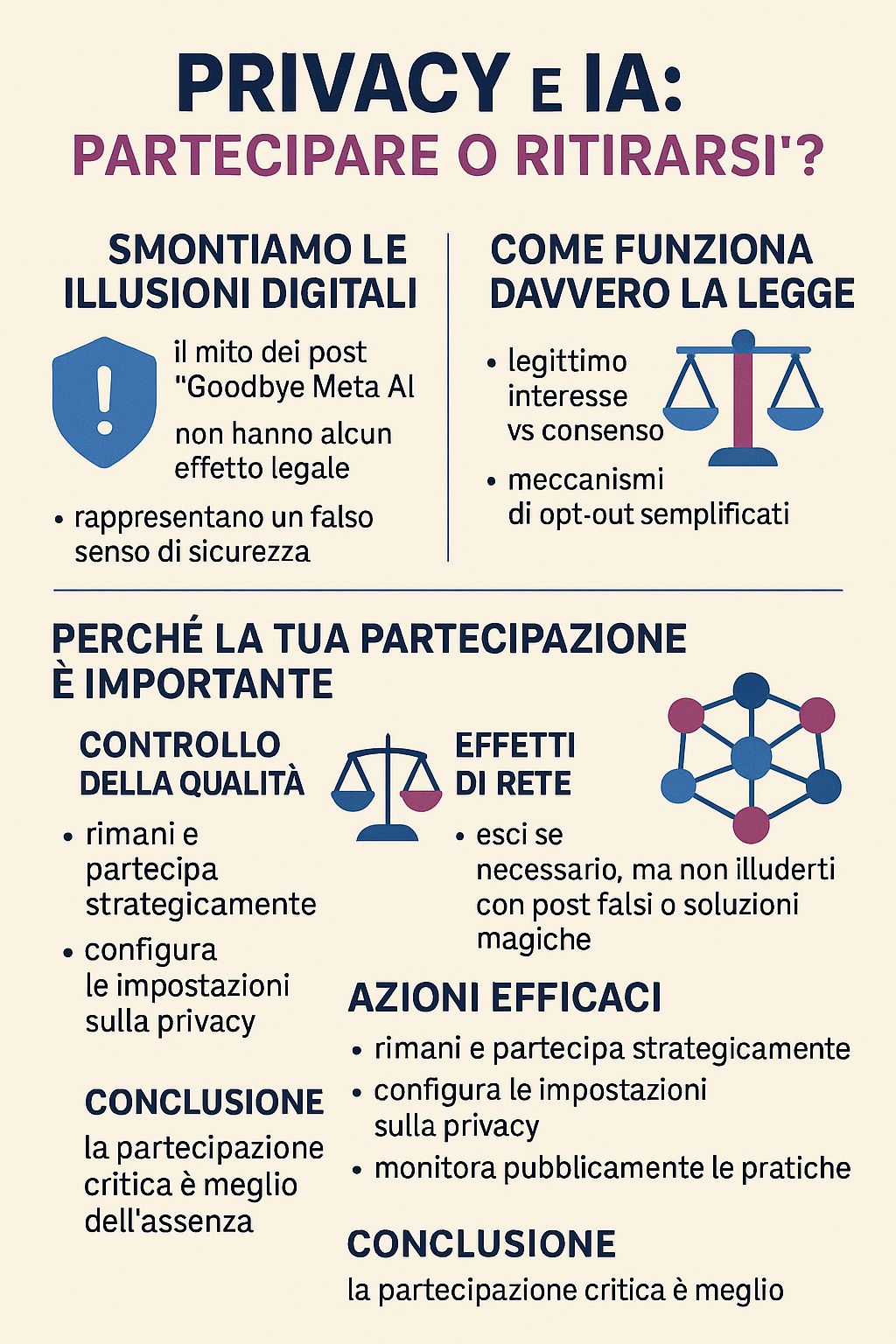

Antes de construir un argumento serio, es fundamental desmontar una peligrosa ilusión que circula en las redes sociales: las publicaciones virales «Goodbye Meta AI» que prometen proteger tus datos con solo compartir un mensaje.

La incómoda verdad: estas publicaciones son completamente falsas y pueden hacerte más vulnerable.

Como explica la propia Meta, «compartir el mensaje «Goodbye Meta AI» no constituye una forma válida de oposición». Estas publicaciones:

El éxito viral de estas publicaciones revela un problema más profundo: preferimos soluciones simples e ilusorias a decisiones complejas e informadas. Compartir una publicación nos hace sentir activos sin tener que esforzarnos por comprender realmente cómo funcionan nuestros derechos digitales.

Pero la privacidad no se defiende con memes. Se defiende con conocimiento y acción consciente.

Desde el 31 de mayo de 2025, Meta ha implementado un nuevo régimen para el entrenamiento de la IA utilizando como base jurídica el «interés legítimo» en lugar del consentimiento. No se trata de una laguna jurídica, sino de una herramienta legal prevista por el RGPD.

El interés legítimo permite a las empresas tratar datos sin consentimiento explícito si pueden demostrar que su interés no prevalece sobre los derechos del usuario. Esto crea una zona gris en la que las empresas «adaptan la ley a su medida» mediante evaluaciones internas.

El uso de datos no anonimizados conlleva «altos riesgos de inversión del modelo, fugas de memorización y vulnerabilidades de extracción». La potencia computacional necesaria significa que solo los actores con una capacidad muy elevada pueden explotar eficazmente estos datos, lo que crea asimetrías sistémicas entre los ciudadanos y las grandes corporaciones.

Ahora que hemos aclarado la realidad jurídica y técnica, construyamos el argumento para la participación estratégica.

Cuando las personas conscientes se rinden, la IA se entrena con los que quedan. ¿Quieres que los sistemas de IA se basen principalmente en datos de personas que:

Los sesgos en la IA se producen cuando los datos de entrenamiento no son representativos. Tu participación contribuye a garantizar:

Los sistemas de IA mejoran con la escala y la diversidad:

Si utilizas funciones basadas en IA (búsqueda, traducción, recomendaciones, herramientas de accesibilidad), tu participación contribuye a mejorarlas para todos, incluidos los futuros usuarios que más las necesitan.

Tu privacidad no cambia significativamente entre optar por participar y optar por no participar en la IA. Los mismos datos ya alimentan:

La diferencia radica en si estos datos también contribuyen a mejorar la IA para todos o solo sirven a los intereses comerciales inmediatos de la plataforma.

Esta es precisamente la razón por la que personas responsables como tú deberían participar. Retirarse no detiene el desarrollo de la IA, sino que simplemente elimina tu voz de él.

Los sistemas de IA se desarrollarán de todos modos. La pregunta es: ¿con o sin la contribución de personas que reflexionen críticamente sobre estos temas?

Es comprensible. Pero piensa en esto: ¿preferirías que los sistemas de IA se construyeran con o sin la contribución de personas que comparten tu escepticismo hacia las grandes corporaciones?

Tu desconfianza es precisamente la razón por la que tu participación crítica es tan valiosa.

La inteligencia artificial se está convirtiendo en una realidad, participes o no.

Tu elección no es si se construirá la IA, sino si la IA que se construya reflejará los valores y perspectivas de las personas que reflexionan cuidadosamente sobre estos temas.

Optar por no participar es como no votar. No detiene las elecciones, solo significa que el resultado no tendrá en cuenta tu contribución.

En un mundo en el que solo los actores con una gran capacidad computacional pueden interpretar y aprovechar eficazmente estos datos, tu voz crítica en la formación puede tener más impacto que tu ausencia.

Quédate y participa estratégicamente si:

Y mientras tanto:

Pero no te hagas ilusiones con:

Tu renuncia individual tiene un impacto mínimo en tu privacidad, pero quedarte tiene un impacto real en todos.

En un mundo en el que los sistemas de IA determinarán el flujo de información, las decisiones y las interacciones entre las personas y la tecnología, la cuestión no es si estos sistemas deben existir, sino si deben incluir el punto de vista de personas reflexivas y críticas como tú.

A veces, la acción más radical no es rendirse. A menudo, lo más radical es quedarse y asegurarse de que se escuche tu voz.

Anónimo

No se trata de confiar ciegamente en las empresas o ignorar las preocupaciones relacionadas con la privacidad. Se trata de reconocer que la privacidad no se defiende con memes, sino con una participación estratégica y consciente.

En un ecosistema donde las asimetrías de poder son enormes, tu voz crítica en el entrenamiento de la IA puede tener más impacto que tu ausencia protestataria.

Sea cual sea tu elección, elige con conciencia, no con ilusiones digitales.

Un párrafo de simpatía también para los «ermitaños de la privacidad», esas almas puras que creen poder escapar por completo del rastreo digital viviendo fuera de línea como monjes tibetanos del 2025.

Spoiler: aunque te vayas a vivir a una cabaña perdida en los Dolomitas, tus datos ya están por todas partes. Tu médico de cabecera utiliza sistemas digitales. El banco donde guardas tus ahorros para comprar leña registra cada transacción. El supermercado del pueblo tiene cámaras y sistemas de pago electrónico. Incluso el cartero que te trae las facturas contribuye a los conjuntos de datos logísticos que alimentan los algoritmos de optimización.

El aislamiento digital total en 2025 significa, esencialmente, autoexcluirse de la sociedad civil. Puedes renunciar a Instagram, pero no puedes renunciar al sistema sanitario, bancario, educativo o laboral sin que ello tenga consecuencias dramáticas para tu calidad de vida.

Y mientras construyes tu cabaña anti-5G, tus datos siguen existiendo en las bases de datos de hospitales, bancos, aseguradoras, ayuntamientos, agencias tributarias, y se siguen utilizando para entrenar sistemas que influirán en las generaciones futuras.

La paradoja del ermitaño: tu aislamiento protestatario no impide que los sistemas de IA se entrenen con los datos de las personas menos conscientes, pero te excluye de la posibilidad de influir en su desarrollo en direcciones más éticas.

En esencia, has conquistado la pureza moral incontaminada de quien observa la historia desde las gradas, mientras que otros, menos ilustrados pero más presentes, escriben las reglas del juego.

Sea cual sea tu elección, elige con conciencia, no con ilusiones digitales.

Artículos citados:

Más información sobre el RGPD y el interés legítimo:

Recursos oficiales:

Para acciones concretas: si te encuentras en Europa, consulta los procedimientos oficiales de exclusión voluntaria en la Autoridad de Protección de Datos. Para obtener información general, consulta la configuración de privacidad y los términos de servicio de tu plataforma. Y recuerda: ninguna publicación en las redes sociales tiene valor legal.